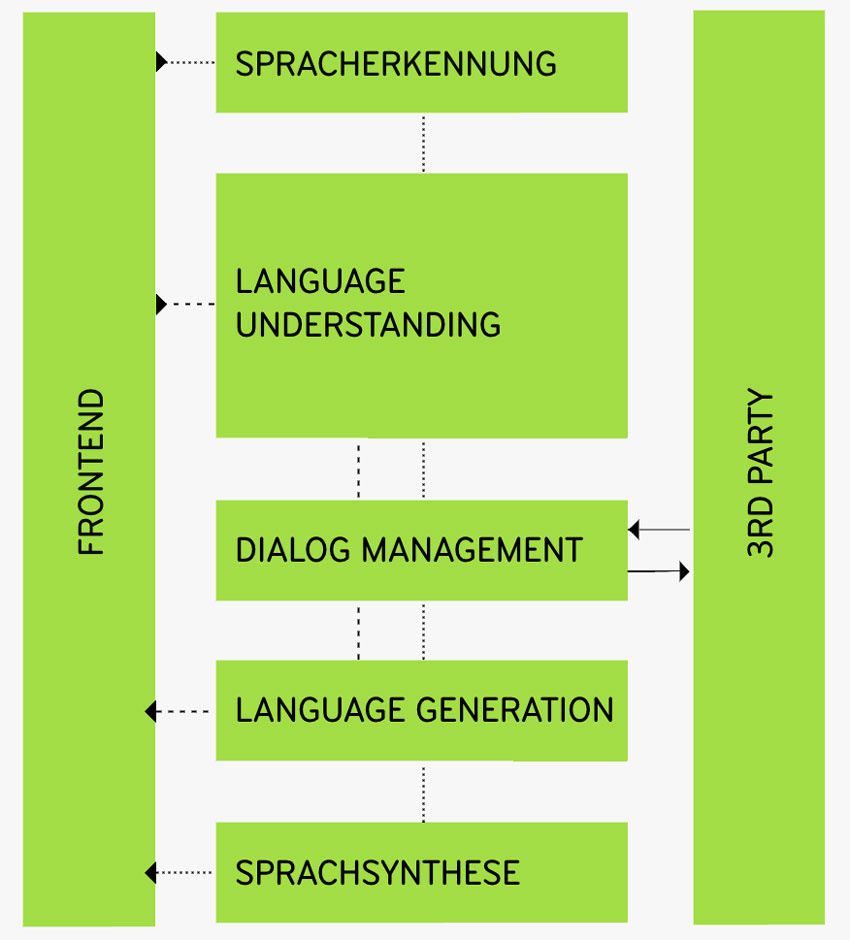

Wenn ich dem Chatbot meiner Lieblingspizzeria via Facebook Messenger schreibe, dass ich eine Pizza Hawaii geliefert bekommen möchte, ist der Facebook Messenger das Frontend des Bots. Das Frontend schickt meine Nachricht in die Language Understanding Schicht, welche zwei Dinge aus meiner Frage herausließt, meine Intention und eventuelle Zusatzinformationen. Die Fachbegriffe hierfür sind „Intents“ und „Entities“. Der Intent fasst die Intention des Nutzers meistens in einem Wort zusammen. Die Entities sind klassifizierte Informationen die der Nutzer mitgibt. Am Beispiel sieht das folgendermaßen aus: {Intent: Pizzabestellung; Entities: {Sorte: Hawaii; Straße: Heger-Tor-Wall; Hausnummer: 19; Stadt: Osnabrück}}.

Diese Infos gibt die Language Understanding Schicht weiter an das Dialog Management, welches entscheidet was zu tun ist. Bei meiner Pizzabestellung greift es auf das ERP System der Pizzeria zu um zu prüfen, ob alle notwendigen Zutaten auf Lager sind und wie viele Pizzen bereits bestellt wurden um eine Lieferzeit abzuschätzen. Final sendet es der Language Generation Schicht den Auftrag mir zu antworten. Mit den Informationen vom Dialog Management {Bestellung: erfolgreich; Lieferzeit: 45min; Sorte: Hawaii} formuliert die Language Generation Schicht den Satz „Ich habe gute Nachrichten, deine Pizza Hawaii ist in ca. 45 Minuten bei dir.“ und schickt sie zum Frontend.