Euer Claim bei virtualQ lautet „Wir schaffen das Warten ab!“ – Wie seid Ihr auf diesen Gedanken gekommen und was bedeutet das genau?

Die Idee ist in meiner damaligen Wohngemeinschaft entstanden. Dort hatten wir Probleme mit einem großen Internet- und Telekommunikationsanbieter und wandten uns mit unserem Anliegen telefonisch an den Kundenservice. Mein Mitgründer Ulf harrte dabei insgesamt 40 Minuten in der Warteschleife aus, um letztendlich aus der Leitung geworfen zu werden. Die Konsequenz, die wir damals für uns zogen: ein Anbieterwechsel, da eine solche Situation für uns absolut nicht akzeptabel, und – noch wichtiger – alles andere als kundenfreundlich war.

Diesem Umstand wollten wir entgegenwirken und entwickelten die entsprechende Technologie – virtualQ. Sie beinhaltet beispielsweise ein virtuelles Warten, bei dem wir die Position des Nutzers in einer Telefonwarteschleife einnehmen und ihn informieren, sobald er an der Reihe ist. Darüber hinaus gehören aber auch eine auslastungsbasierte Terminvergabe oder die Glättung der aus dem Kundenservice bekannten M-förmigen Tagesverlaufskurve zu unseren Services.

Neben dem intelligenten Warteschleifen-Management bietet Ihr auch eine Sprachintelligenz, also einen AI Service an. Wie genau funktioniert das und was sind die Vorteile?

Wir bieten beispielsweise Voice-Assistenten zur Datenerfassung, Zählerstanderfassung oder zur Beantwortung von FAQs an. Das Besondere ist, dass die beiden Komponenten des Intelligenten Wartens und der Sprachintelligenz ineinander übergreifen. Die Sprachintelligenz steckt also auch im intelligenten Warteschleifen-Management, beispielsweise bei der Terminvereinbarung. Der Benefit für den Anwender liegt insbesondere darin, dass die Sprachintelligenz schnell Informationen erfasst, dokumentiert und kommuniziert. Die Unternehmen profitieren im Gegenzug von gesunkenen Anrufzahlen und weniger panischen Usern, die versuchen über die Social-Media-Kanäle Kontakt aufzunehmen. Zusätzlich bieten die Unternehmen ihren Kunden eine Serviceleistung über die normalen Öffnungszeiten hinaus an. Ein gutes Beispiel dafür ist der Unfall mit einem Mietwagen. Durch ein Telefonat mit dem entsprechenden AI-Service – auch außerhalb der normalen Servicezeiten – werden in solchen Situationen die wesentlichen Fragen des Nutzers unmittelbar beantwortet, während alle weiteren Details in Ruhe zu einem späteren Zeitpunkt geklärt werden können. Das gibt dem Kunden Sicherheit in einer so schwierigen Lage.

Habt Ihr spannende Projekte, von denen Du uns berichten kannst?

Die Gothaer Versicherungsgruppe ist ein tolles Beispiel. Dort haben wir unsere Funktionalitäten in die hauseigene App der Gothaer integriert. Unser System hilft bei der Bearbeitung von Versicherungsfällen wie etwa Sturmschäden. Der Versicherte kann direkt einsehen, wie lang die Wartezeiten für den Kundenservice sind. Bei Bedarf erhält er dann eine Push-Notification, sobald er zurückrufen kann. Den Zeitpunkt des tatsächlichen Anrufs kann er dabei jedoch selbst bestimmen. Diese „Freedom of Choice“ ist uns beim Kundenservice besonders wichtig, denn die führt zu einer höheren Kundenzufriedenheit.

Ein weiteres Beispiel ist das Unternehmen Lexware der Haufe Gruppe. Dort liefern wir Sprachbots für verschiedene Kundenanliegen sowie die dahinterliegende „Analytics-Power“, um die Anfragen datenbasiert auszuwerten. So findet eine bessere Vorqualifizierung der User statt und es verdeutlicht die Anrufgründe der Kunden. Wir bilden IVR-Systeme mit Natural Language ab, damit die Anrufe dann reinkommen, wenn ein Agent tatsächlich frei ist und die Anfrage des Kunden behandeln kann. Diese Kombination der Services von virtualQ ist sehr stark.

Welche Herausforderungen begegnen Euch aktuell?

Unsere Herausforderung liegt derzeit weniger auf der technischen, sondern eher auf der unternehmerischen Seite. Letztes Jahr wurden wir von der Gründerszene als das am schnellsten wachsende Technologie Start Up Deutschlands ausgezeichnet und wir müssen dieses rasante Wachstum entsprechend managen. Wir sind quasi jedes halbe Jahr ein neues Unternehmen und dafür braucht man natürlich auch die richtigen Leute. Ich bin überzeugt davon, dass das auch eine der aktuellen Herausforderungen der Kundenservicebranche ist: Wenn man echte Top Entwickler und Data Scientists akquirieren will, muss man als Unternehmen attraktiv sein und spannende Aufgaben bieten können. Ich glaube, bei virtualQ hat unsere Chefin Anika Baumann einen herausragenden Job gemacht und wir haben innerhalb der Belegschaft eine gute Balance zwischen jungen und erfahrenen Talenten hinbekommen.

Kannst Du erzählen, woran Ihr gerade arbeitet?

Intelligenz ist im Moment das Stichwort für uns und unsere Kunden. Wir möchten mit unserem Data-Science-Team an die Leistungen und an das Knowledge von den ganz großen Servicecentern anknüpfen und diese auch für Callcenter mit weniger Agenten verfügbar machen. Da befinden wir uns auf einem guten Weg.

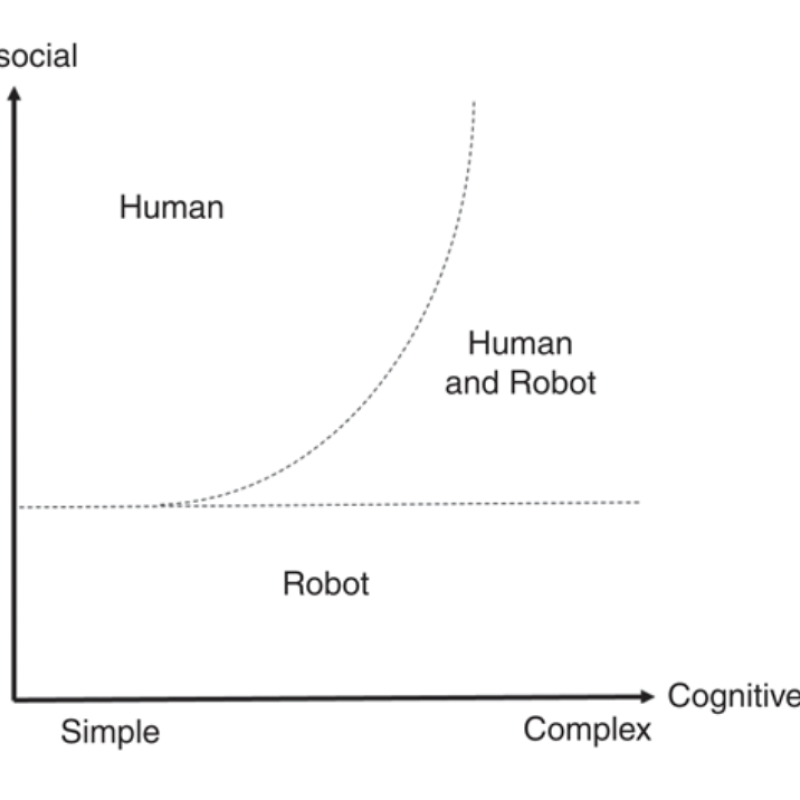

Wie wird sich Deiner Meinung nach der Kundenservice in Zukunft entwickeln?

Verglichen mit anderen Bereichen wie Marketing oder Sales hängt der Kundenservice in meinen Augen in der Innovationsumsetzung noch etwas hinterher. Grundsätzlich wird die Bedeutung des Kundenservices jedoch zukünftig immer weiter ansteigen. Themen wie Online-Marketing kann und macht heutzutage jedes Unternehmen. In Zukunft werden nur noch die Unternehmen überleben, die den besten Kundenservice bieten und damit herausstechen. Hier spielt auch das Stichwort Switching Economy eine große Rolle, denn Nutzer können bei Unzufriedenheit mit nur einem Klick den Anbieter wechseln. Es kommt somit in Zukunft noch stärker darauf an, den Kunden zu verstehen und auf seine Wünsche einzugehen.

Vielen Dank, Jens!

Für klassische Callcenter und den Kundenservice der Zukunft gewinnen die Themen Künstliche Intelligenz und digitale Agenten immer mehr an Bedeutung. virtualQ hat diese Chance erkannt und zum Geschäftsmodell gemacht. Weitere Interviews mit Technologie-Anbietern, Dienstleistern und KI-Experten zu diesem Thema, sowie ein akkurates und detailreiches Stimmungsbild über den Status Quo des Conversational-Service-Ansatzes finden Sie in unserem Whitepaper.

Jetzt Whitepaper herunterladen!